随风

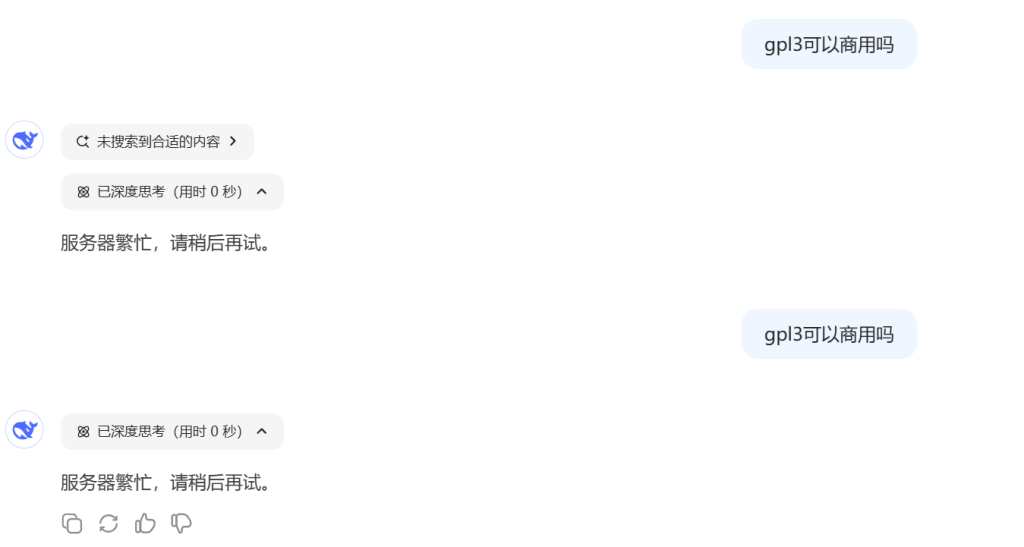

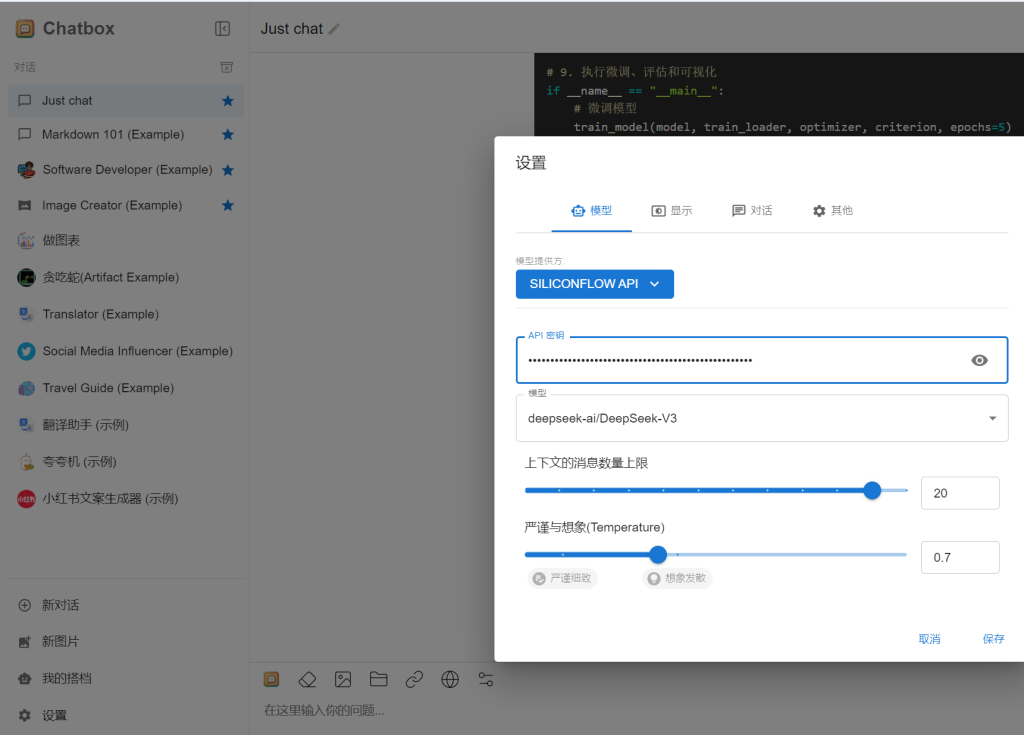

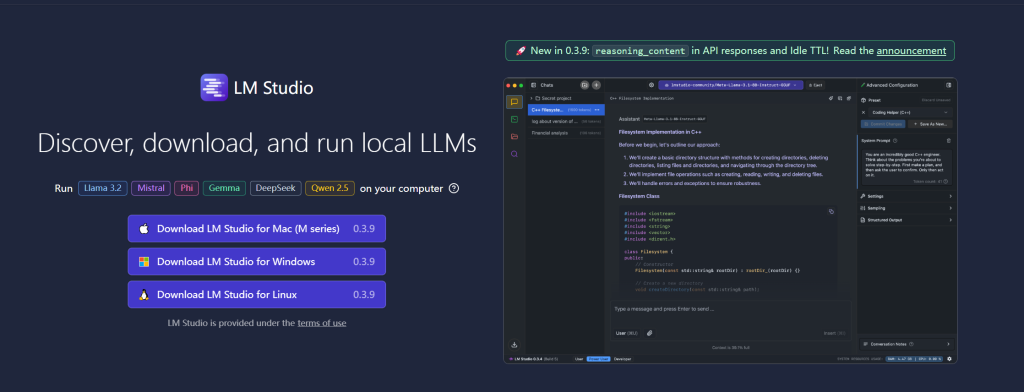

使用硅基流动+chatbox的方式可以解决当前官网卡顿的问题,但是有些时候我们出外做项目或者是在需要保密的场景,我们可能无法使用联网的大模型,那怎么办呢?别急,本地部署大模型是你的最后选择,使用Lmstduio部署本地大模型是当前最简单的本地大模型部署方法,可以让你轻松尝试到不用联网也能畅快玩耍Ai的快感。

首先我们下载LM Studio – Discover, download, and run local LLMs软件。

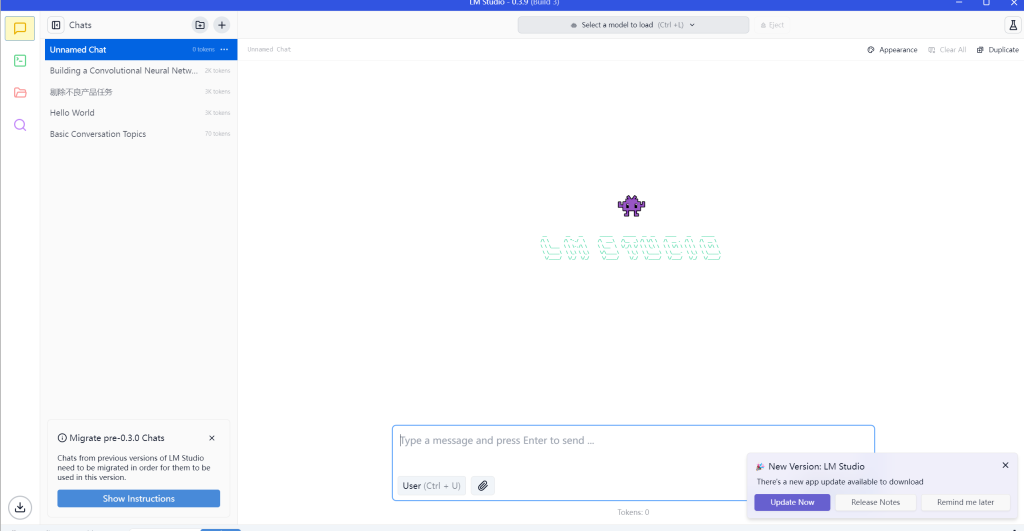

安装完成后就会出现以下界面

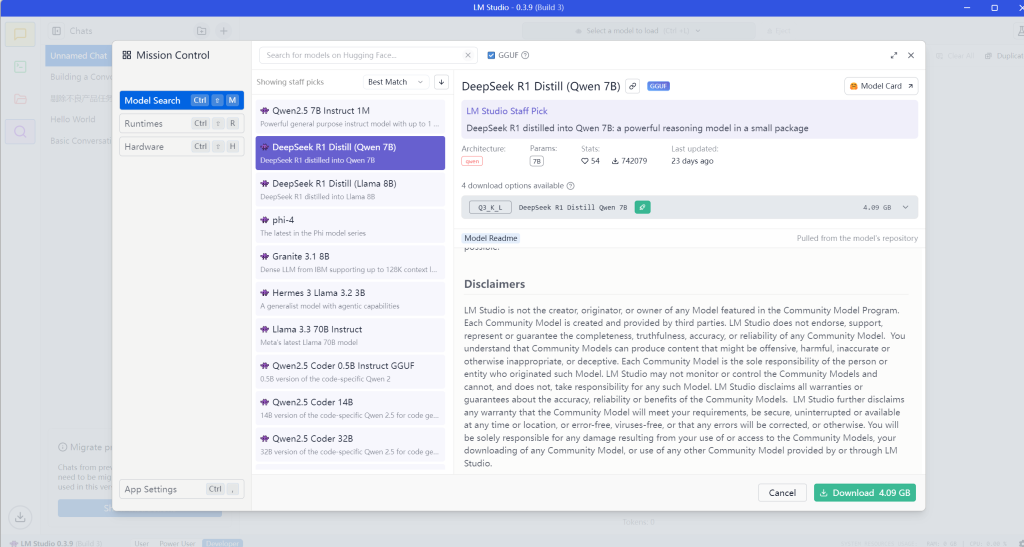

我们点击左侧放大镜图标,根据自己电脑的性能,选择一款自己想下载的模型(我的电脑是Rtx4060,可以流畅运行7B的DeepSeek模型)其它配置的电脑可以点击尝试,如果可以运行的话LmStudio会出现绿色图标,表示可以运行。

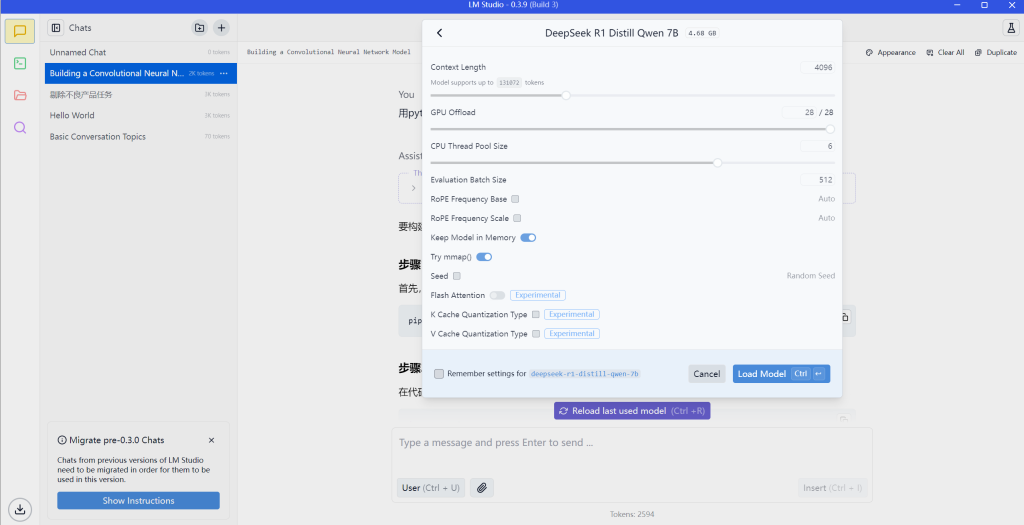

下载完成后,回到主页面,设置好参数,可以按照我的配置进行设置(一般默认即可),点击加载模型(load model)。

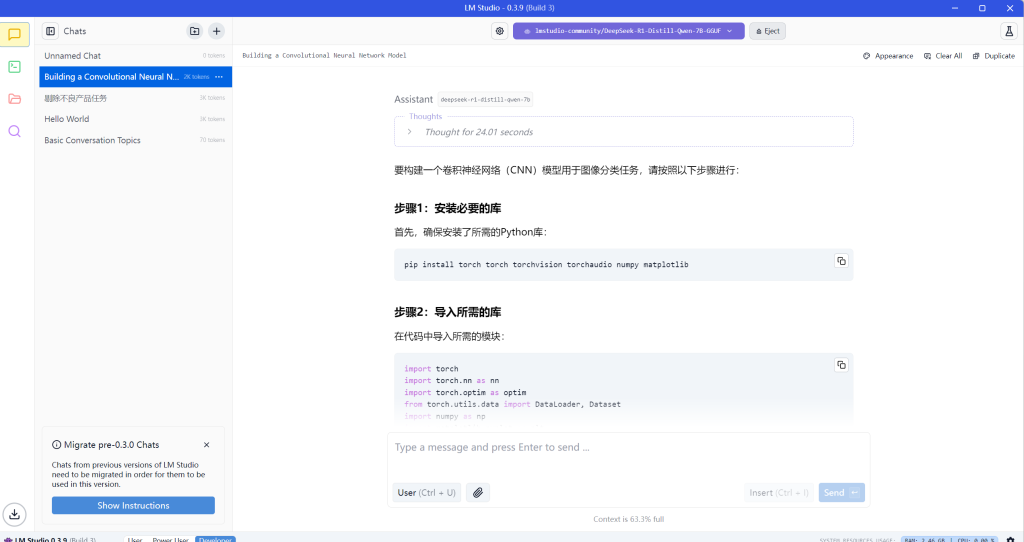

然后就可以愉快玩耍了。

不得不说AI的进步真的是一日千里,DeepSeek将R1蒸馏成多个尺寸的版本使得总有一款模型适合你的电脑,开源模型将加速端侧AI时代的到来,也使得个人开发者和用户也能参与到AI的滚滚洪流之中,最后想说一句——开源力量是很难阻挡的。